Do jakich problemów nadają się komputery kwantowe?

Obejrzyj film o zastosowaniach obliczeń kwantowych autorstwa Olivii Lanes lub otwórz go w osobnym oknie na YouTube.

Wprowadzenie

W poprzedniej lekcji zajęliśmy się jednym problemem dogłębnie – rozwiązaniem problemu optymalizacyjnego Max-Cut przy użyciu sformułowania QUBO. Dzisiaj przyjmiemy inne podejście i omówimy szerzej zastosowania w bliskim horyzoncie czasowym. Zaczniemy od przedstawienia, jak decydujemy o rodzajach problemów, które mogą skorzystać z rozwiązania kwantowego. Następnie przyjrzymy się kilku niedawnym przykładom prac wykonanych w naszej społeczności. Pomoże to rozwinąć intuicję dotyczącą różnych typów problemów obliczeń kwantowych oraz sposobu ich rozwiązywania.

Trudność klasyczna a kwantowa

Zanim przejdziemy do przykładów, omówmy najpierw, jak badamy i kategoryzujemy trudność różnych problemów. Niektóre problemy można łatwo rozwiązać na komputerze klasycznym i nie potrzebujemy komputera kwantowego, aby je rozwiązać. Z drugiej strony istnieją bardzo trudne problemy, do rozwiązania których komputery kwantowe są niezbędne. Jednym ze słynnych przykładów jest znajdowanie czynników pierwszych ogromnych liczb całkowitych. Szyfrowanie RSA opiera się na trudności tego problemu, a algorytm Shora został zaprojektowany, aby rozwiązać go na komputerze kwantowym. Innym przykładem jest znajdowanie rozwiązania w nieposortowanym zbiorze danych – teoretycznie można go rozwiązać za pomocą algorytmu kwantowego znanego jako algorytm Grovera. Jednak większość ekspertów zgadza się, że tego typu algorytmy będą wymagały implementacji korekcji błędów, a technologia po prostu jeszcze tam nie dotarła.

Szukamy więc problemów, z którymi możemy zmierzyć się gdzieś w słodkim punkcie pomiędzy bardzo łatwymi a bardzo trudnymi – takich, z którymi dzisiejsze komputery kwantowe sobie poradzą, ale komputery klasyczne mają problem.

Klasy złożoności

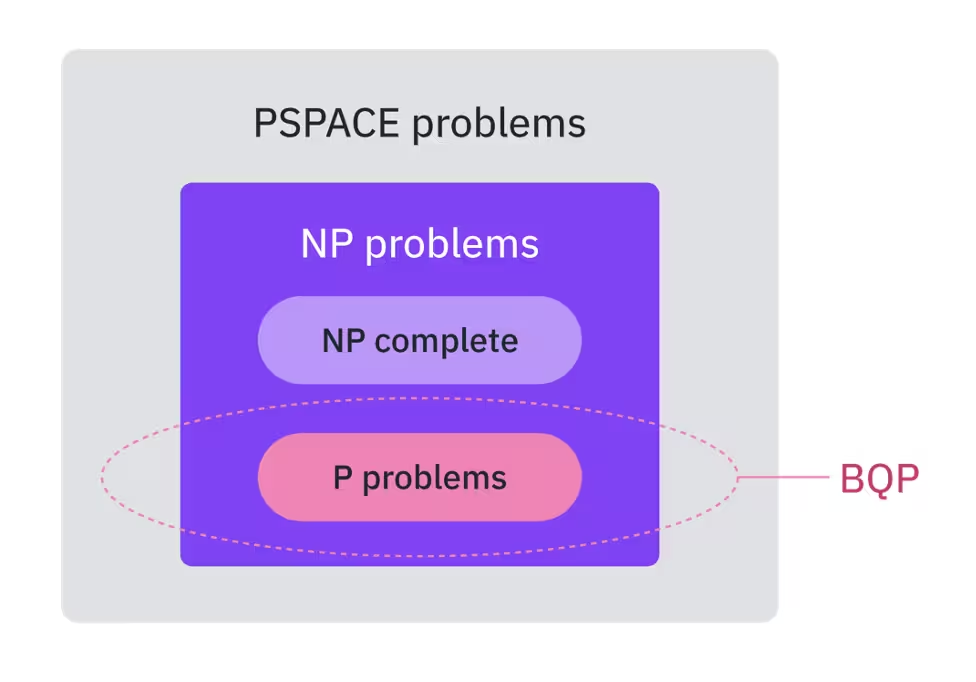

Trudność tych problemów jest kategoryzowana i analizowana w dziedzinie informatyki zwanej teorią złożoności obliczeniowej. W klasycznych obliczeniach istnieje mnóstwo różnych klas złożoności, ale do najbardziej fundamentalnych należą:

- P: Problemy, które można rozwiązać w czasie wielomianowym wraz ze wzrostem skali problemu. Są łatwe do rozwiązania.

- NP: Oznacza niedeterministyczny wielomianowy. Tych problemów niekoniecznie można rozwiązać w czasie wielomianowym, ale ich odpowiedzi można zweryfikować w czasie wielomianowym.

- NP-zupełne to najtrudniejsze problemy w NP i nie mają znanego rozwiązania wielomianowego. To tutaj żyją słynne problemy takie jak problem komiwojażera i gra Sudoku.

- BPP, czyli problemy wielomianowe z ograniczonym błędem, które można rozwiązać w pewnym zakresie błędu przez probabilistyczny komputer klasyczny w czasie wielomianowym.

Gdy wymyślono koncepcję obliczeń kwantowych, ludzie włożyli znaczne wysiłki, aby ustalić, jakie klasy problemów te nowe typy komputerów będą w stanie efektywnie rozwiązywać. Wymyślono nową klasę problemów:

- BQP, czyli kwantowe problemy wielomianowe z ograniczonym błędem. Jest to kwantowy odpowiednik BPP: klasa problemów decyzyjnych rozwiązywalnych przez komputer kwantowy w czasie wielomianowym z niewielką szansą błędu.

Wszystkie te klasy znajdują się w większej klasie zwanej PSPACE. Powyżej znajduje się diagram przypuszczalnych relacji między niektórymi klasami złożoności, ale jest to bardzo trudne do definitywnego udowodnienia matematycznie. Zauważysz, że BQP niekoniecznie pokrywa się z NP-zupełnymi. Ale mogłeś/aś nadal widzieć niektóre podejścia obliczeń kwantowych, które próbują rozwiązywać problemy z klasy NP-zupełnych.

Jednym powszechnym błędnym przekonaniem jest to, że nie ma sensu badać rozwiązań kwantowych dla problemów, dla których nie znaleziono matematycznego dowodu przyspieszenia kwantowego. Ale matematyczny dowód, że algorytm kwantowy jest szybszy od swojego klasycznego odpowiednika, jest trudny do znalezienia. Algorytmy Shora i Grovera są dwoma z zaledwie kilku przykładów, w których dotychczas tego dokonano. W rzeczywistości rygorystyczne udowodnienie, że P i NP są różne, jest jednym z najbardziej znanych otwartych pytań w całej matematyce, mimo że cała intuicja podpowiada nam, że muszą być.

Ale sposób, w jaki algorytm skaluje się wraz ze wzrostem rozmiaru problemu – co odzwierciedla klasa złożoności – nie zawsze jest najbardziej istotną cechą algorytmu. To skalowanie jest często scenariuszem najgorszego przypadku. Jest całkiem możliwe, że w praktyce scenariusz najgorszego przypadku nie jest tym, który najczęściej napotykamy.

To, że dowody trudności są podchwytliwe, nie oznacza, że nie możemy dokonać postępu. Wprowadzamy ideę rozwiązań heurystycznych. Jeśli jesteś eksperymentatorem, prawdopodobnie znasz i kochasz tego typu rozwiązania. Heurystyka to dowolne podejście do rozwiązywania problemu, które jest pragmatyczne, ale niekoniecznie optymalne, ponieważ rozwiązania nie muszą być optymalne, aby były użyteczne. Na przykład pomyśl o zastosowaniach finansowych. Nie znaleźliśmy jeszcze wykładniczego przyspieszenia dla większości algorytmów finansowych, do których mogłyby być użyte obliczenia kwantowe, ale nie potrzebujemy optymalnego rozwiązania. W finansach nawet rozwiązanie, które jest tylko o 0,1% bardziej efektywne, mogłoby oznaczać miliardy dolarów zysku.

Dzisiejsze komputery kwantowe i ich ograniczenia

Jak więc dowiadujemy się, które przypadki użycia i problemy mogłyby być odpowiednie dla obliczeń kwantowych już teraz? Czy istnieje dobry powód, aby wierzyć, że użyteczność kwantowa, a nawet przewaga, może być znaleziona teraz lub w najbliższej przyszłości?

Może łatwiej najpierw nazwać rzeczy, których problem z pewnością nie powinien mieć. Nie może wymagać ogromnej liczby kubitów. Nie mamy jeszcze procesorów z tysiącami lub milionami dostępnych kubitów. To jedna z głównych przyczyn, dla których algorytm Shora i podobne są tak dalekie od realizacji. Obwody również nie mogą być zbyt głębokie. Granica głębokości obwodu zależy od wielu czynników, ale generalnie, jeśli Twój eksperyment wymaga głębokości, której nie widziałeś/aś jeszcze osiągniętej w literaturze, prawdopodobnie nie zadziała. I wreszcie, żaden typ algorytmu, o którym wiemy, że będzie wymagał korekcji błędów, nie może być jeszcze wykonany.

Wszystkie te ograniczenia są uwzględnione w planie rozwoju IBM Quantum® i spodziewamy się osiągnąć korekcję błędów na początku lat 30. XXI wieku, ale na razie musimy szukać eksperymentów, które wykorzystują większość kubitów dostępnych obecnie na danym QPU. Podkreślamy również znaczenie łagodzenia i tłumienia błędów. I wreszcie, powinno istnieć oczywiste rozszerzenie do przyszłych zastosowań, które byłyby ważne dla społeczeństwa i które moglibyśmy dostrzec jako ostatecznie prowadzące do przewagi kwantowej.

Obszary zastosowań i przypadki użycia

Porozmawiajmy teraz o kilku przykładach przypadków użycia, które dzielą się na trzy główne kategorie, które zidentyfikowaliśmy jako najbardziej prawdopodobne do osiągnięcia korzystnych wyników w bliskim i średnim horyzoncie czasowym:

-

Symulacje natury. Obecne klasyczne metody symulacji atomowych i molekularnych są ograniczone przez nieefektywne matematyczne opisy struktury atomowej. Przechowywanie i manipulowanie stanem kwantowym wymaga wykładniczo wielu zasobów na komputerze klasycznym, ale może być efektywnie wykonane na komputerze kwantowym. Może to prowadzić do rozwoju w sekwestracji dwutlenku węgla, alternatywnych bateriach lub wynalezieniu nowych leków. Niektóre algorytmy szczególnie istotne w tym obszarze to: Variational Quantum Eigensolver (VQE), używany do szacowania pewnych właściwości materiału, takich jak stany równowagi lub minimum energii; algorytm Time Dynamics Simulation (TDS), używany do szacowania funkcji odpowiedzi lub właściwości spektralnych materiałów; oraz nowicjusz, Sample-based Quantum Diagonalization (SQD), o którym, jak sądzimy, będziemy słyszeć znacznie więcej w najbliższej przyszłości.

-

Optymalizacja. Ten obszar jest wszechobecny w obliczeniach, więc przypadków użycia jest wiele i są różnorodne. Niektóre przykłady, o których często słyszymy, to optymalizacja portfela w finansach, projektowanie przemysłowe oraz dystrybucja i łańcuch dostaw. Najczęstszym algorytmem, o którym prawdopodobnie usłyszysz w związku z finansami, jest ten, który już omówiliśmy szczegółowo: kwantowy przybliżony algorytm optymalizacyjny, czyli QAOA.

-

Kwantowe uczenie maszynowe. Ten obszar wzbudził wiele entuzjazmu w ostatnich latach, ale jest prawdopodobne, że QML nie będzie użyteczne tak szybko jak symulacja. Niemniej jednak istnieją imponujące algorytmy, nad którymi pracuje się, aby rozwiązać kilka bardzo ważnych przypadków użycia. Niektóre z tych możliwych przypadków użycia to przetwarzanie języka naturalnego, analiza ruchu sieciowego, a nawet wykrywanie oszustw w transakcjach finansowych. Istotne algorytmy w tym obszarze to kwantowa maszyna wektorów nośnych (QSVM), kwantowe sieci neuronowe (QNN) oraz kwantowe generatywne sieci przeciwstawne.

W ramach tych szerokich obszarów zastosowań społeczność dostrzega korzyść w grupach pracujących razem, które koncentrują się na bardziej konkretnym temacie. IBM® zainicjował inicjatywę o nazwie Grupy Robocze, aby pomóc współpracownikom poznać się nawzajem i tworzyć produktywną synergię w czterech konkretnych obszarach: opieki zdrowotnej i nauk przyrodniczych, materiałów i obliczeń wysokiej wydajności (HPC), fizyki wysokich energii oraz optymalizacji. Ostatnio utworzono piątą grupę roboczą zajmującą się zrównoważonym rozwojem.

Teraz przyjrzymy się bliżej kilku problemom, które zostały niedawno podjęte przez niektóre z tych grup roboczych. Głównym celem nie jest zrozumienie każdego szczegółu eksperymentu – to może być onieśmielające nawet dla ekspertów, jeśli artykuł jest nieco poza Twoim obszarem specjalizacji. Celem jest po prostu pomoc w rozwinięciu intuicji co do rodzajów problemów, do których nadają się komputery kwantowe, oraz jak sobie z nimi radzić. A jeśli jesteś zainteresowany/a, zachęcamy do przeczytania pełnych artykułów.

Przypadek użycia 1: Symulacja dynamiki hadronów

Najpierw zagłębimy się w artykuł grupy Martina Savage'a z University of Washington pt. Quantum Simulations of Hadron Dynamics in the Schwinger Model Using 112 Qubits.

Jeśli nie jesteś fizykiem wysokich energii, nadal możesz znać termin „hadron”, jak w Wielkim Zderzaczu Hadronów (LHC), który jest gigantycznym akceleratorem cząstek o obwodzie 27 km, który umożliwił w końcu zaobserwowanie bozonu Higgsa. Hadron jest subatomową cząstką złożoną składającą się z innych małych cząstek zwanych kwarkami. Niektóre przykłady hadronów to neutrony i protony.

Dla pewnego kontekstu, LHC został zbudowany, aby umożliwić badanie fizyki fundamentalnej poprzez zderzanie cząstek przy bardzo wysokich energiach. Dzięki LHC naukowcy mają nadzieję dowiedzieć się więcej o wczesnym wszechświecie i fundamentalnych prawach natury. W zasadzie interakcje tych cząstek mogłyby być symulowane od początku do końca za pomocą wystarczająco potężnego komputera kwantowego. Nie jesteśmy jeszcze całkiem na miejscu, ale czynimy postępy.

Model Schwingera jest popularnym, prostym modelem używanym do symulacji niektórych z tych dynamik. Jest to model opisujący zachowanie elektronów i pozytonów oddziałujących za pośrednictwem fotonów w 1+1D, co oznacza czas i jeden wymiar przestrzenny. Model ma wiele podobieństw do chromodynamiki kwantowej (QCD), która opisuje, jak oddziałują kwarki i hadrony, ale QCD jest niezwykle trudna do symulacji. Dlatego model Schwingera jest często używany jako model-zabawka do badania niektórych zjawisk wspólnych dla obu.

Aby zrozumieć, dlaczego zajęli się tym problemem, zadajmy sobie serię pytań.

Po pierwsze, dlaczego mieli powody sądzić, że symulowanie tego na komputerze kwantowym w ogóle zadziała? W tym przypadku elektrony i pozytony w modelu Schwingera wykazują efekt ekranowania, powodujący, że korelacje między odległymi fermionami zanikają wykładniczo wraz z odległością. Oznacza to, że nie ma aż tak wielu koniecznych oddziaływań dalekiego zasięgu między kubitem po jednej stronie chipa a drugą, które – jak wiemy – są bardzo podatne na błędy. A więc jest to świetne dla dostępnego dziś sprzętu.

Następnie, dlaczego ten temat jest interesujący? Fizyka wysokich energii w ogólności budzi ogromne zainteresowanie. Ludzie byli gotowi wydać miliardy dolarów na budowę LHC, a wiele tysięcy naukowców i techników na całym świecie poświęciło swoje kariery tej dziedzinie. Chociaż model Schwingera jest uproszczony i nie jest zaprojektowany tak, aby obejmował trzy wymiary przestrzenne, nadal stanowi użyteczne uproszczenie pełnej teorii.

Wreszcie, jak ta praca została wykonana, albo jak podeszlibyśmy do tego problemu, gdybyśmy chcieli kontynuować te prace? W eksperymentach typu symulacyjnego VQE jest jednym z najczęstszych podejść, a pierwszy krok jest prawie zawsze taki sam: przygotowanie stanu podstawowego. W tym przypadku jest to stan próżni. W tym eksperymencie używają nowej wersji VQE o nazwie SC-ADAPT-VQE (co oznacza Scalable Circuits - Adaptive Derivative-Assembled Pseudo-Trotter ansatz-VQE), aby przygotować zarówno stan podstawowy, jak i pakiet falowy hadronów na tej próżni. Kolejnym krokiem jest umożliwienie hadronom ewolucji w czasie. Na koniec należy zidentyfikować obserwable, które chcemy zmierzyć, i je zmierzyć.

Jeśli te kroki brzmią nieco znajomo, z wyjątkiem części dotyczącej pakietu falowego hadronów, to dlatego, że są one bardzo podobne do tych, które omawialiśmy w przykładzie QAOA w poprzedniej lekcji. Zaczynamy od znanego stanu (tu stanu próżni), a następnie pozwalamy mu ewoluować w czasie z serią eksponencjalnie zapisanych Hamiltonianów. Wiele algorytmów wariacyjnych podąża za tym ogólnym podejściem. Dużą różnicą jest jednak to, że tworzymy pakiet falowy hadronów wyśrodkowany w naszym obwodzie, zanim pozwolimy mu ewoluować.

Jak więc tworzymy pakiet falowy? Na próżni hadron można wzbudzić, tworząc parę fermion-antyfermion na sąsiednich węzłach. Przygotowując superpozycję takich hadronów w różnych miejscach, można przygotować dowolny pakiet falowy. Autorzy wyśrodkowali swój pakiet falowy w środku obwodu, aby obserwować ewolucję bez napotkania granicy.

Ale pamiętaj: przy pracy z zaszumionymi QPU celem gry jest utrzymanie głębokości obwodu na poziomie zarządzalnym. Aby to osiągnąć, protokół SC-ADAPT-VQE wykorzystuje symetrie i hierarchie w skalach długości do określenia obwodów kwantowych o małej głębokości do przygotowania stanu. Dzięki temu powstanie ansatz o mniejszej liczbie parametrów, a tym samym o mniejszej głębokości.

Eksperyment przeprowadzono na urządzeniu IBM Quantum Heron i obejmował on kilka różnych typów łagodzenia i tłumienia błędów: dynamiczne odsprzęganie, ekstrapolację zerowego szumu, twirling Pauliego oraz niedawno opracowaną technikę zwaną renormalizacją dekoherencji operatora.

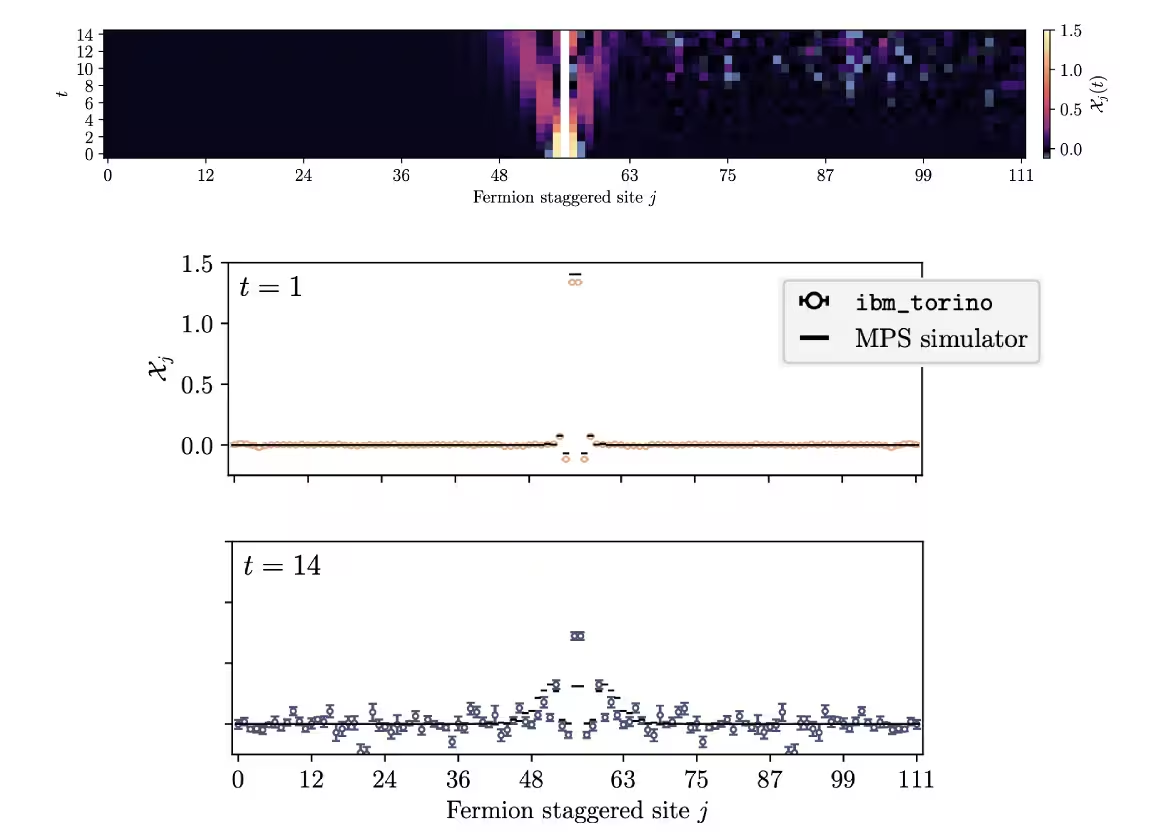

Powyżej znajduje się rysunek z artykułu przedstawiający interesującą obserwablę – kondensat chiralny, który jest w zasadzie nadciekłą fazą hadronów. Teraz widzimy pakiet falowy w środku węzłów wyznaczonych do przeprowadzenia tego eksperymentu. Czarne linie to bezbłędne wyniki z (kosztownej obliczeniowo) symulacji klasycznej, podczas gdy punkty ze słupkami błędów to wyniki z 133-kubitowego komputera kwantowego IBM, Torino.

Widzimy dwa różne kroki czasowe w ewolucji pakietu falowego. W czasie widać, że kondensat chiralny jest wąski i zlokalizowany, a także dobrze pasuje do symulacji klasycznej. Przy jest znacznie bardziej rozproszony. Porównanie z symulatorem nie jest teraz tak doskonałe, ale nadal można wyraźnie zauważyć bardzo dobrą zgodność między teorią a danymi, co jest zachęcające.

Podsumowując, jest to bardzo fajny przykład rodzaju pracy symulacyjnej, do której początkowo możesz nie pomyśleć o zastosowaniu obliczeń kwantowych, ale który pokazuje realny potencjał. Nie jest to idealne, ale nie trzeba być ekspertem od fizyki cząstek elementarnych, aby zauważyć, że komputer kwantowy dokładnie przewiduje propagację pakietu falowego na zewnątrz, co jest dokładnie tym, czego byśmy się spodziewali. Miejmy nadzieję, że przyszłe prace w tej dziedzinie będą kontynuowane, a fizycy wysokich energii będą nadal znajdować sposoby włączenia obliczeń kwantowych do swoich procesów pracy. Celem jest rozwiązywanie trudnych problemów teoretycznych z większą precyzją i wykorzystanie eksperymentów do akceptacji lub odrzucenia teorii w nadziei na odkrycie nowej fizyki, budowę ulepszonych detektorów i doprowadzenie do lepszego zrozumienia natury na jej najbardziej fundamentalnym poziomie.

Przypadek użycia 2: Optymalizacja szkła spinowego Isinga

Nasz następny przykład skupia się na optymalizacji i będzie dogłębną analizą artykułu zatytułowanego Bias-Field Digitized Counterdiabatic Quantum Optimization, który został wykonany przez członków zespołu Kipu Quantum i Uniwersytetu Kraju Basków w Hiszpanii.

W artykule autorzy opracowali nową metodę optymalizacji i zastosowali ją do znalezienia stanu podstawowego szkła spinowego Isinga. Jak omawialiśmy wcześniej, wiele kombinatorycznych problemów optymalizacyjnych można przeformułować jako rozwiązywanie stanów niskoenergetycznych Hamiltonianów Isinga. Model Isinga opisuje oddziaływanie macierzy mikroskopijnych spinów. W pewnych reżimach model przewiduje, że spiny zachowują się jak szkło, w którym momenty magnetyczne są nieuporządkowane powyżej tak zwanej „temperatury zamrażania”.

Zaczniemy, jak poprzednio, od serii definicji. Pierwszą jest kontradiabatyczna, która jest rodzajem ewolucji tłumiącym efekty nieadiabatyczne doświadczane przez system, niezależnie od tego, jak szybko te procesy zachodzą. Przypomnij sobie twierdzenie adiabatyczne z ostatniego odcinka – zazwyczaj trzeba ewoluować system bardzo powoli, jeśli chce się, aby pozostał w stanie podstawowym. Jest to duży problem, ponieważ im wolniej musimy rozwijać sprawy, tym więcej mamy czasu na wystąpienie błędów. Napędzanie kontradiabatyczne (CD) ma na celu zwalczanie tego poprzez dodawanie członów, które przeciwdziałają tym niechcianym wzbudzeniom. Główną ideą jest przyspieszenie całego eksperymentu i zmniejszenie głębokości obwodu kwantowego poprzez tłumienie wzbudzeń, które mogłyby powodować pasożytnicze przejścia.

Teraz drugi element żargonu z tytułu: pole tendencyjne. Inne algorytmy iteracyjne, takie jak VQE, przyjmują klasyczne parametry w stanach i używają klasycznych optymalizatorów do przeszukiwania wielowymiarowej przestrzeni parametrów w celu znalezienia zestawu parametrów, który daje minimalną wartość oczekiwaną dla ustalonego Hamiltonianu. W tym przypadku zamiast tego zmieniają oni za każdym razem Hamiltonian, przechodząc adiabatycznie od znanego przypadku do przypadku będącego przedmiotem zainteresowania. Aby zmienić Hamiltonian, po prostu bezpośrednio stosują wartość oczekiwaną Pauli-Z z jednej iteracji jako pole tendencyjne w Hamiltonianie dla następnej iteracji. W ten sposób sterują dynamiką w kierunku rzeczywistego rozwiązania bez potrzeby użycia klasycznych optymalizatorów.

Dlaczego więc ten eksperyment jest interesujący? Szkła spinowe Isinga mają fundamentalne znaczenie w fizyce, ale to nowe podejście jest jeszcze bardziej ogólne. Można je zastosować do wielu problemów optymalizacyjnych, więc artykuł ma szerokie zainteresowanie.

A dlaczego sądziliśmy, że to zadziała? Algorytm, który proponują, przyspiesza ewolucję w celu zmniejszenia głębokości obwodu, jednocześnie tłumiąc nieadiabatyczne przejścia. Co więcej, nie opiera się on na żadnych klasycznych podprogramach optymalizacyjnych, co może stanowić problem prowadzący do jałowych płaskowyżów i utknięcia w minimach lokalnych. Wreszcie, autorzy zadbali również o dopasowanie oddziaływań w problemowym Hamiltonianie do łączności sprzętowej w rzeczywistych QPU, co jest zawsze bardzo ważne.

Jak więc działa ta metoda? Ponownie, nie używa żadnych klasycznych optymalizatorów, w przeciwieństwie do większości innych iteracyjnych algorytmów kwantowych. Zamiast tego, podając rozwiązanie z każdej iteracji jako dane wejściowe do następnej, algorytm zdigitalizowanej kwantowej optymalizacji z polem tendencyjnym stopniowo udoskonala stan podstawowy, zbliżając go coraz bardziej do końcowego wyewoluowanego stanu. A w połączeniu z protokołami kontradiabatycznymi możemy to zrobić nawet z obwodami kwantowymi o małej głębokości, które powinny działać płynnie na zaszumionym sprzęcie.

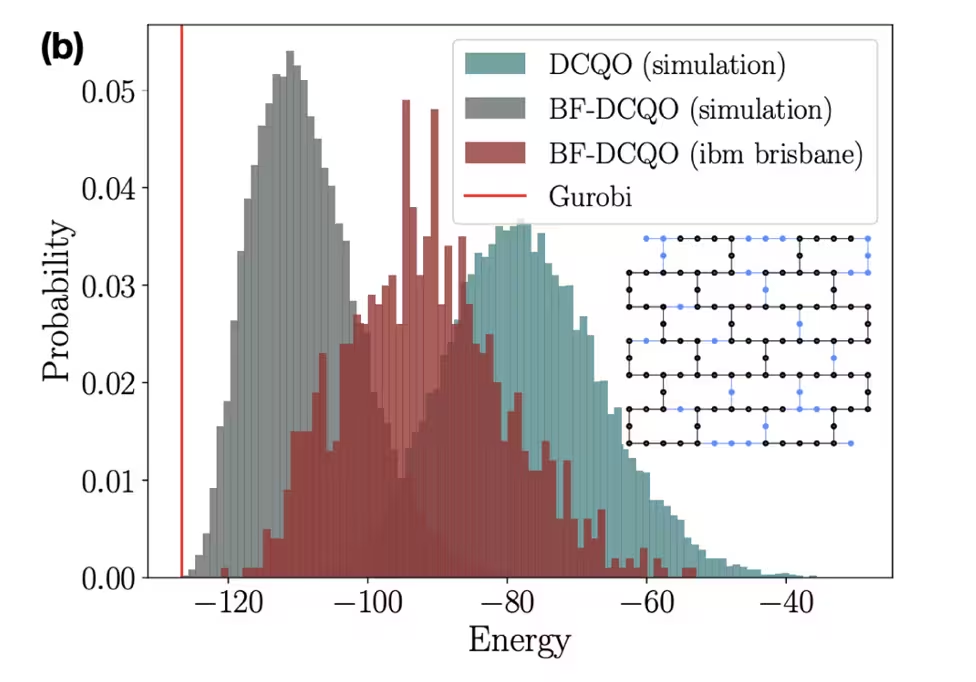

Kiedy więc eksperyment został przeprowadzony, autorzy zdecydowali się uruchomić algorytm na 127-kubitowym komputerze kwantowym IBM Brisbane. Poniżej znajduje się rysunek przedstawiający 8. iterację algorytmu optymalizacyjnego dla losowo wygenerowanej instancji szkła spinowego z najbliższymi sąsiadami na 100 kubitach. Porównują oni wyidealizowane wyniki klasycznej symulacji z DCQO i BF-DCQO, a także wynik eksperymentalny uruchomiony na komputerze kwantowym. Pokazują również wynik z klasycznego solvera o nazwie Gurobi jako odniesienie. Zaledwie po 10 iteracjach BF-DCQO zapewnia drastyczną poprawę w porównaniu do DCQO. Chociaż wynik eksperymentalny jest nieco inny niż wynik idealny z powodu szumu, wydajność jest nadal lepsza niż idealne DCQO. To pokazuje, że wciąż dokonuje się wiele doskonałych postępów w zakresie optymalizacji kwantowej, a dobre wyniki są po raz pierwszy raportowane dla ponad 100 kubitów.

Przypadek użycia 3: Przewidywanie struktury drugorzędowej mRNA

Na koniec omówimy artykuł firmy Moderna Pharmaceuticals zatytułowany mRNA Secondary Structure Prediction Using Utility-Scale Quantum Computers.

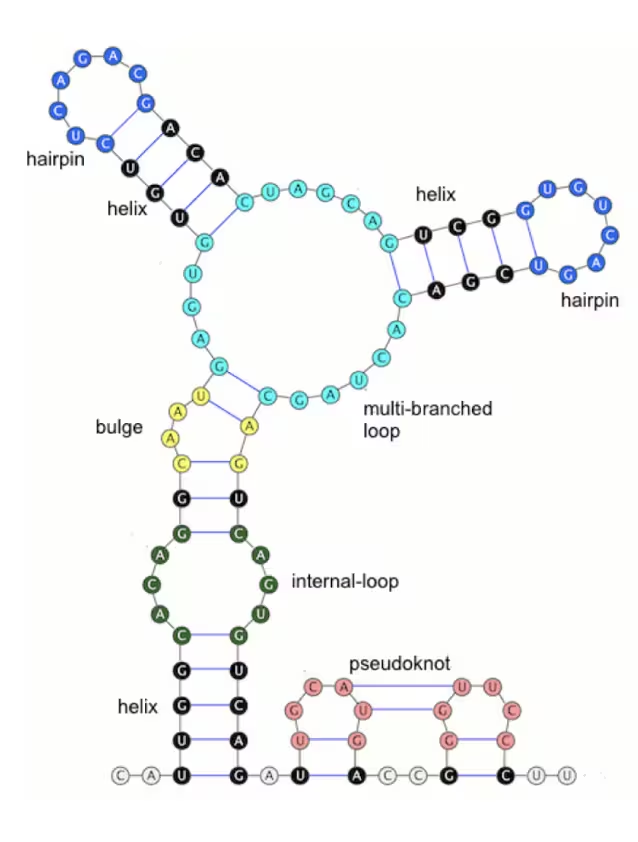

Najpierw krótkie przypomnienie o mRNA. Informacyjny RNA to rodzaj RNA zaangażowany w syntezę białek. W zasadzie odczytuje on instrukcje przekazywane przez DNA. Struktura drugorzędowa mRNA to sposób, w jaki łańcuch jest złożony, co pokazano na poniższym diagramie. A problem przewidywania struktury drugorzędowej RNA polega na znalezieniu najbardziej stabilnego zwinięcia sekwencji zasad lub nukleotydów tworzących RNA: adeniny (A), cytozyny (C), uracylu (U) i guaniny (G). Poniższy obraz przedstawia kilka typowych struktur fałdowania występujących w mRNA, każdy kolor reprezentuje inny typ struktury drugorzędowej. To, co czyni jedną strukturę korzystniejszą od innych, nie jest dobrze zrozumiane; wszystko, co możemy zrobić, to obliczyć, która struktura daje najniższą energię swobodną w porównaniu ze stanem niezwiniętym. I tu pojawiają się komputery kwantowe.

Dlaczego więc struktury drugorzędowe mRNA są ważne? Dokładne ich przewidywanie jest kluczowe nie tylko dla zrozumienia DNA i naszych genów, ale także dla projektowania terapii opartych na RNA, takich jak szczepionka na COVID-19.

Od dawna wiadomo, że jest to potężny problem optymalizacyjny dla klasycznych komputerów ze względu na ogromną liczbę możliwych konfiguracji. Dla niektórych konfiguracji wiadomo, że jest to problem NP-zupełny. Jednak na komputerze kwantowym możemy sformułować przewidywanie struktury drugorzędowej jako problem optymalizacji binarnej – coś, z czym potrafimy sobie poradzić. Co więcej, w literaturze istniały już dowody na dokładne przewidywania RNA na urządzeniach kwantowych i symulatorach kwantowych na małą skalę. Ale czy zadziała to na większym sprzęcie?

Ten eksperyment przeprowadzono przy użyciu tzw. wariacyjnego kwantowego solvera wartości własnych z warunkową wartością ryzyka, który jest modyfikacją tradycyjnego algorytmu VQE i oczekuje się, że osiągnie lepszą zbieżność.

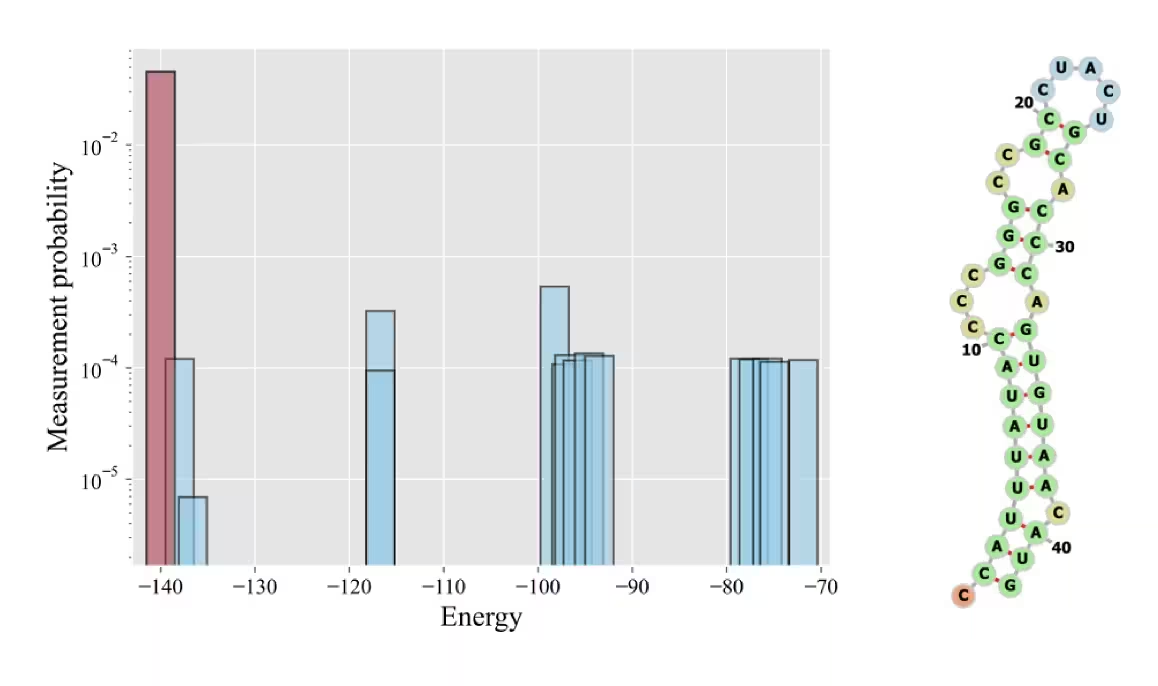

Wykres powyżej pokazuje rozkład prawdopodobieństw pomiaru próbkowanych ciągów bitów, z odpowiadającymi im energiami dla instancji 42-nukleotydowej, 80-kubitowej. Tutaj ciągi bitów symbolizują parowania nukleotydów. Ilustruje to, że ciąg bitów o najniższej energii znaleziony przez komputer kwantowy odpowiada temu z porównywalnego solvera klasycznego, więc to jest świetne. Pokazano również optymalną strukturę zwinięcia tego łańcucha nukleotydów na podstawie ciągu bitów o najniższej energii znalezionego przez komputer kwantowy.

Podsumowanie

Mamy nadzieję, że te trzy przypadki użycia dały ci wystarczający kontekst, aby zrozumieć, jak obecnie wygląda przełomowa praca w tej dziedzinie, i pewność siebie, aby próbować nowych eksperymentów kwantowych, których być może wcześniej nie podejmowałeś.

Pamiętaj: obliczenia kwantowe nie są dobre dla każdego problemu. I naprawdę jest to tylko świadectwo tego, jak dobrzy staliśmy się w obliczeniach klasycznych. To, że myślisz, że mógłbyś zastosować obliczenia kwantowe do danego problemu, nie oznacza, że da to interesujące wyniki; musisz wziąć pod uwagę skalowanie.